Le plaisir de l’interaction entre l’usager et les objets TIC numériques The pleasure of the interaction between the user and the ICT numeric objects

L’interactivité dénomme l’entrée de données par un usager dans un système informatique ainsi que la réponse du système. Ce processus nécessite une action coordonnée entre l’usager et la machine que l’on nomme souvent interaction. C’est la fonction principale de l’interface de permettre au minimum l’entrée et la sortie des données et l’activation de commandes. Mais cette médiation doit opérer tant sur le plan rationnel, intelligible que sur le plan émotionnel et sensible parce que les deux sont interdépendants. Donner envie, c’est suggérer ou générer du plaisir, des émotions positives. Ceci dit, la plupart des travaux menés sur les interfaces comme source de plaisir, se focalisent sur le design des formes, des couleurs, des matières, oubliant les effets de sens de la relation gestuelle entre l’usager et la machine. Nous faisons l’hypothèse que les gestes requis par le dispositif matériel et informatique pour interagir avec la machine peuvent constituer une modalité c’est‐à‐dire un ensemble de règles spécifiques porteur de signification mais aussi des formes iconiques qui génèrent du sens dans leur relation avec le corps de l’usager. Chaque type d’interaction gestuelle se fonde sur un système de valeurs singulier, sur un mode d’être à l’objet spécifique qui est pour l’usager en situation porteur de (dé)plaisir.

The interactivity names the entry of data by a user to a computer system as well as the answer of the system. This process requires an action coordinated between the user and the machine that we name interaction. It is the main function of the interface to allow at least the entry and the exit of the data and the activation of commands. But this mediation has to operate both on the rational, understandable plan and on the emotional and sensitive plan, – the two plans are interdependent–, generating some pleasure, positive feelings during the interaction between the user sand the numeric object. However, most of the works published on the interfaces as the sources of pleasure, focus on the design of the forms, the colors, the materials, forgetting the effects of sense of the gestural relation between the user and the machine. We make the hypothesis that gestures required by the material and ICT device to interact with the machine can constitute a modality that is a set of specific rules carrier of significance but also iconic forms which generate sense in their relation with the body of the user. Every type of gestural interaction bases itself on one value systems singular which generate (dis)pleasure for the user in situation.

1. Introduction

- Note de bas de page 1 :

-

Cf. Caelen Jean, Définition et caractérisation des IHM, http://www‐clips.imag.fr/geod/User/jean.caelen/cours %20accessibles_fichiers/IntroIHM.pdf

- Note de bas de page 2 :

-

Cf. Sabatier Delphine, « iPad Je l’aime … moi non plus », SVM, mars 2010. p. 8‐9.

Depuis plus de dix ans, les usagers comme les designers sont en quête d’interfaces‐objets dites « intuitives », « conviviales ». Ces qualificatifs toujours aussi valorisants socialement mais recouvrant pourtant des acceptions fort différentes selon chacun de nous semblent accompagner voire sous‐tendre l’évolution de la technologie et du design. En 2003, Thierry Gobert, dans sa thèse intitulée Qualification des interactions observables entre l’homme et les machines numériques dotées d’interfaces à modalités virtuelles, expliquait en effet que l’évolution des langages informatiques s’inscrivait dans un souci de simplification qualifiée par le chercheur d’« intuitive ». Les applications, les logiciels permettaient dès lors aux usagers de se passer de l’apprentissage du code, facilitant ainsi la mise en place d’« un mode relationnel d’échange qui prendrait l’apparence d’un face à face » (2003, 43). En 2001, Michela Denis, chercheur en design d’objet, expliquait de son côté que l’évolution du design d’objets en général allait dans le sens d’une « gratification de l’utilisateur […] grâce à l’aspect apparemment intuitif de l’objet ». Selon elle, la convivialité repose sur « l’intuitif », à savoir sur des éléments faciles à trouver. Thierry Gobert ajoute l’importance de l’aspect esthétique dans la notion de « convivialité » (2003, 85) et Jean Caelen définit une interface conviviale comme un système « avec qui l’on aime vivre »1. Michela Deni (2002) souligne, et c’est très important pour comprendre l’existence d’une pluralité de sens attribués aux qualificatifs « intuitif », « convivial », que ces derniers ne correspondent pas à des réalités matérielles stables, communes à tous, mais à des constructions sémiotiques, c’est‐à‐dire à des effets de sens, des interprétations que chacun attribue, selon les modes, les goûts, à telle ou telle interface. Ainsi, notons que s’il y a une douzaine d’années, Joël De Rosnay (1989, 9) percevait la souris comme un élément de plaisir, de simplicité, intensifiant la relation entre l’usager et l’ordinateur (cité par Gobert, 2003, 58), Donald A. Norman en 2007 y voit un obstacle à une relation de plaisir. Pour ce designer, au même titre que tous les périphériques et que la médiation de l’écran, la souris élimine le plaisir du contact direct de l’objet réel, physique (2007, 79‐80). Actuellement, Apple selon les discours d’escorte, révolutionnerait nos vies en proposant avec l’iPhone puis l’iPad des interfaces de téléphone et de tablettes tactiles. Le magazine SVM, dans son numéro de mars 2010, allait en ce sens : « […] les applis, conçues pour l’iPad vont fleurir et nous découvrirons là les pépites attendues […]. Pour nous, c’est une belle promesse, la perspective de vous offrir demain SVM sous forme numérique enrichie. La couleur, l’instantanéité, l’interactivité… Toucher la photo de l’iPad pour découvrir notre test en vidéo … […] Observer la tête de nos copains sceptiques, le jour où ils auront la tablette d’Apple entre les mains ! ».2

Aujourd’hui, dans un effet de mode construit par Apple et les médias, le ton est emphatique quant aux interfaces tactiles, pourtant certains avis personnels comme celui d’Etienne Mineur (2010) placent le plaisir de l’interaction gestuelle dans d’autres types d’interfaces. Selon ce dernier en effet, toucher un écran en verre pour communiquer ou s’informer, c’est se couper du corps matériel de l’information (il prend l’exemple, par opposition à l’écran de verre, de la lettre papier avec la trace des larmes ou encore des informations non verbales que donne le corps en face à face). L’interaction gestuelle sur écran tactile, c’est pour le designer interactif qu’est Etienne Mineur source de déplaisir car, l’écran fait écran et le fait de le toucher fait prendre conscience de l’obstacle. Etienne Mineur comme Donald A. Norman préconisent la mise en place d’interfaces tangibles qui redonneraient à la relation entre l’usager et l’objet numérique une source de plaisir. Cela dans la mesure où elle donneraient un aspect palpable aux signes grahiques (icônes, boutons) : « Fortunately, some designers of many computer based products are restoring the natural affective pleasures of the real, tangible world. » (2007, 80). Ces différents points de vue montrent qu’une interface ne peut pas être intuitive, son essence même étant de construire une médiation culturellement orientée.

La multiplication progressive des catégories d’objets numériques (téléphones portables avec écran tactile, tablettes tactiles…) constituant des supports matériels pour lire des sites web ou des applications ad hoc pose une question particulière : de plus en plus, le designer de sites, applications, doit penser l’interface graphique du « contenu » en fonction de la spécificité de l’interface matérielle (pas forcément souris‐ écran‐clavier physique) alors qu’au début des années 2000 encore, il suffisait de penser au dispositif souris‐écran‐clavier, à la lisibilité du site sur différents navigateurs et à l’adaptation à la taille de l’écran. Or, la spécificité de l’interface matérielle n’est pas seulement la forme, la taille, la couleur mais elle englobe aussi le mode d’interaction gestuelle. Nous entendons par geste tout mouvement physique (de la main, de la jambe, de la tête, …) requis par les interfaces des objets numériques pour entrer des données, pour déclencher une action.

Nous faisons l’hypothèse que le plaisir lié à l’utilisation d’un objet numérique peut avoir des sources diverses. En effet, il peut être lié à l’esthétique, et/ou lié à la performance, et/ou lié aux fonctionnalités, etc. mais aussi lié à la relation gestuelle. Chaque source est en tension avec l’autre de manière complexe et spécifique à chaque usage ainsi que selon chaque usager. Or, les travaux en sémiotique ont souvent privilégié le sens de l’expérience esthétique que l’usager peut faire d’un objet numérique ou l’analyse du Faire pragmatique, avec les modalités d’actions définies par les icônes sans prendre en compte véritablement le sens du geste.

Dans ce papier, nous proposons d’analyser les modes d’interaction gestuelle sollicités par les interfaces matérielles d’objets numériques afin de définir précisément les différents systèmes de valeurs sur lesquels peut se fonder le plaisir de nature gestuelle. Les gestes requis par le dispositif matériel et informatique pour interagir avec l’objet TIC à système de commande dans le but de telle ou telle action (appuyer sur un bouton au clavier, pincer les doigts sur un écran tactile pour rétrécir une image, les écarter pour l’agrandir, souffler au micro ou face à la webcam pour éteindre une bougie avec une reconnaissance des mouvements), semblent constituer, c’est notre hypothèse, une modalité c’est‐à‐dire un ensemble de règles spécifiques, fondée sur un système de valeurs singulier porteur de signification mais aussi des formes iconiques qui génèrent du sens dans leur relation avec le corps de l’usager.

Les différents statuts qui fondent la relation gestuelle proposée par les objets TIC numériques semblent constituer chacun une source particulière de plaisir. Nous définissons le plaisir comme le sentiment d’être présent à l’objet, d’y attacher de la valeur, d’en faire une préhension positive. En l’occurrence, le plaisir lié à l’interaction gestuelle porte à la fois sur l’objet médié par l’interface (objet‐cible de l’action) et à la fois sur l’objet médiateur de l’interaction objet‐contrôle de l’action). Husserl repris par Pierre Ouellet qualifie « l’attitude de plaisir » non théorique, non fondée sur un jugement de valeurs mais sur une appréciation, un sentiment positif de « préhension intuitive et affective ». Si le plaisir peut être considéré comme liquidation d’un manque et satisfaction du résultat atteint ou encore comme sentiment de plénitude de l’existence de soi, il peut aussi, comme le font Husserl et Ouellet, être considéré comme un sentiment de présence à l’objet.

« L’attitude de plaisir » lorsque « le sujet vit avec la conscience d’être présent par le sentiment auprès de l’objet […] » (Ouellet, 1998, 33) se vit au cours de l’interaction entre la sensibilité perceptive du sujet et la sensibilité réactive de l’objet :

« Le sujet et l’objet échangent leurs qualités sensibles dans la perception : le premier projette sur le second les états propres à sa sensibilité (ses prégnances) et le second émerge face au premier sous la forme de traits sensibles qui le saisissent (dans ses saillances). […] Nous sommes au monde avant que le monde soit à nous. (Ouellet, 2001) ».

Si le plaisir relève d’un éprouvé, s’il ne donne pas lieu à une analyse de la part de l’usager, du mode d’interaction gestuelle proposé, s’il est ressenti comme intuitif, pour autant, il ne l’est pas contrairement à ce que dit Pierre Ouellet. En effet, c’est dans l’appréciation affective mais aussi axiologique que l’usager vit tel ou tel mode d’interaction gestuelle, tel ou tel mode d’être à l’objet médiateur, – l’interface matérielle et graphique –, et à l’objet médié – l’objet‐cible de l’action. Nous allons justement préciser comment le plaisir de l’interaction se fonde sur des systèmes de valeurs spécifiques.

- Note de bas de page 3 :

-

Cf. note 1.

- Note de bas de page 4 :

-

Pour l’établissement de ce corpus, nous avons coopéré avec Nicolas Mas, un ingénieur spécialiste des innovations technologiques dans le domaine des TIC, appartenant à l’agence Concept SL et avec le Pôle de compétitivité Elopsys situé en Limousin.

Nous entendons par « interface » le système d’échanges, en entrée et en sortie, de données. Même si, comme le précise Jean Caelen, « l’interface n’existe […] pas vraiment en elle‐même : c’est une abstraction, un système d’ingénierie qui permet d’organiser l’interaction et la coordination, […] elle n’est [pour autant] pas dissociable de la machine : l’ensemble, machine + interface, constitue un système interactif »3. Nous avons mené notre recherche à partir d’un corpus d’interfaces d’objets numériques dans les domaines des téléphones mobiles, ordinateurs, Pda, objets communicants, jeux vidéos, construit sur la prise en compte d’une part, des différentes grandes catégories d’objets TIC numériques et, d’autre part, sur l’évolution historique des interfaces des objets de chaque catégorie4.

Dans une première partie, nous interrogeons les spécificités de la relation à l’objet numérique : peut‐on parler d’interaction alors qu’objectivement la relation se fonde sur l’interactivité ? Ensuite, nous situons notre travail par rapport aux recherches menées sur le plaisir de la relation à l’objet. Dans un troisième temps, nous exposons notre méthodologie. Enfin, nous présentons les différents modes sensibles et intelligibles à l’œuvre dans les types d’interaction gestuelle requis lors de l’interaction avec tel ou tel objet numérique.

2. Les spécificités de la relation à l’objet numérique : interactivité ou interaction ?

2.1. En quoi l’objet numérique estil spécifique ?

Nous retiendrons la définition des objets numériques TIC proposée par Stéphane Vial, philosophe et designer (2010, 94) : ce sont des objets « interactifs produits dans des matières informatisées et organisés autour d’une interface [informatique] ». Selon Divina Frau‐Meigs, les objets numériques avec écran font réseau au sens où ils « font système » impliquant plusieurs processus, internes et externes, dans une coordination simultanée ainsi que l’« environnement socio‐matériel de la pensée », selon la formule de Louis Quéré. Il s’ensuit que le rôle de l’objet dépasse la relation mécanique aux réseaux d’acteurs, qu’il devient lui‐même actif dans la coordination et la structure de la tâche à accomplir. » (2011, 63‐64). On a là une puissance du calculateur qui invite les usagers à oublier, lors de leur collaboration avec ces objets, certaines distinctions entre l’homme et l’objet.

Thierry Gobert explique que la relation entre l’homme et l’objet numérique est intensément perçue par l’usager, dans sa relation duelle avec la machine, comme une interaction avec l’investissement affectif et mental que cela suppose. Selon le chercheur, « le contact homme‐ machine est un fait éthologique, constitué par la situation de proximité entre l’individu et l’objet, par les échanges sonores, visuels et tactiles observables. Le micro‐ordinateur, dont il a été montré qu’il est fortement chargé d’attributions individuelles et sociales, est un objet particulier du fait de ses fonctionnalités multiples, de son interface émissive multisensorielle et de son système d’encodage des données à modalités tactiles. » (2003, 262).

Même si la relation entre l’objet numérique et l’usager peut être perçue par ce dernier comme une interaction (relation fondée sur des actions réciproques entre deux ou plusieurs acteurs), Jean Caelen (2007, 52‐55) et Thierry Gobert (2003, 297‐298) précisent que la relation entre l’usager et l’objet numérique muni d’un système de commandes se différencie de deux types de relation. D’une part, de celle de l’usager avec un objet non numérique. Cela, à cause de l’interactivité, ce nécessaire passage par une programmation informatique des actions de commande en entrée (encodage) et, inversement, par une nécessaire traduction, en sortie, du code informatique (décodage).

D’autre part, la relation entre l’usager et l’objet TIC numérique se distingue de la relation d’humain à humain, dans la mesure où la machine ne peut prendre en compte aucune commande en entrée qui n’ait été programmée en conception. L’usager, s’il veut se faire comprendre par la machine, doit obéir aux règles de fonctionnement, de communication, fixées en conception et programmées. Objectivement, les deux acteurs en interaction ne se situent par conséquent pas au même niveau, l’un est programmé, pas l’autre. En ce sens on peut dire que l’interaction entre l’usager et l’objet numérique se fonde sur une relation dissymétrique.

Ces caractéristiques créent une tension entre deux manières d’aborder la relation entre l’usager et l’objet numérique à écran, tension qui se retrouve dans les travaux de Jean Caelan. D’un côté, il définit dans une approche utilitariste la relation entre l’usager et l’objet numérique comme « une relation opérateur/tâche où la machine a un rôle collaboratif » (Caelan, 2007, 53) dans une visée de résultats au moindre coût physique et cognitif, mais d’un autre côté, il se rapproche d’une relation qui serait une interaction avec un investissement affectif et une réciprocité des actions. En effet, dans un article intitulé « Définition et caractérisation des IHM », il précise que l’interface homme‐machine doit donner envie à l’utilisateur d’interagir en suscitant des émotions positives et en se fondant sur les croyances des utilisateurs. On pourrait reformuler ses propos en disant que l’interface doit se couler dans l’intimité de l’usager pour devenir un alter ego, un partenaire ami, non contraignant.

2.2. Notre approche du concept d’interaction

Pour nous, comme le propose le sémioticien Erik Landowski (2005, 41), le concept d’interaction désigne les actions réciproques dans les relations avec les objets aussi bien qu’avec autrui, la nature actorielle du partenaire de la relation pouvant être autant humaine, animale, qu’un objet. Évidemment, pour que cette acception fonctionne (objet pris comme partenaire de l’interaction), il faut que l’on considère le partenaire non pas exclusivement comme un objet au comportement strictement programmé mais comme un sujet doué d’une sensibilité réactive, pas perceptive bien sûr. Erik Landowski définit la sensibilité réactive d’un objet comme sa capacité (prévue lors de sa conception) à réagir très exactement aux impulsions auxquelles nous les soumettons. La sensibilité perceptive est celle qui « nous permet non seulement d’éprouver par les sens les variations perceptibles du monde extérieur (liées à la présence d’autres corps‐sujets ou autres éléments du monde‐ objet) et de ressentir les modulations internes affectant les états du corps propre, mais aussi d’interpréter l’ensemble de ces solutions de continuité en termes de sensations différenciées faisant elles‐mêmes sens » (2005, 44). Le sémioticien explique qu’il existe plusieurs régimes d’interaction, valables quelle que soit la nature de notre partenaire (objet, humain, animal).

Nous en retiendrons deux qui a priori se retrouvent dans les types d’interaction gestuelle avec les objets numériques. La programmation tout d’abord qui se fonde sur la seule relation de cause à effet dans une relation instrumentalisée du sujet qui agit de façon fonctionnelle sur l’objet. L’ajustement ensuite. Les partenaires de l’interaction se voient dotés d’un corps et par la même d’une sensibilité, réactive ou perceptive. Ils sont capables de sentir réciproquement (2005, 43). C’est une « interaction entre égaux, où les parties coordonnent leurs dynamiques sur le mode d’un faire ensemble. » (2005, 42).

- Note de bas de page 5 :

-

. Cf. Drouillat Benoît, (16 septembre 2010), « Interfaces gestuelles : un pas en arrière dans la facilité d’usage ? » http://magazine.designersinteractifs.org/actualite/ interfaces‐gestuelles‐un‐pas‐en‐arriere‐dans‐la‐facilite‐dusage.

- Note de bas de page 6 :

-

Voici ce que dit Jacob Nielsen à propos du design d’interaction ambigu des applications pour iPad : « To exacerbate the problem, once they do figure out how something works, users can't transfer their skills from one app to the next. Each application has a completely different UI for similar features.

In different apps, touching a picture could produce any of the following 5 results : Nothing happens

Enlarging the picture

Hyperlinking to a more detailed page about that item

Flipping the image to reveal additional pictures in the same place (metaphorically, these new pictures are "on the back side" of the original picture)

Popping up a set of navigation choices ».

Cf. Nielsen, Jacob, (May 10, 2010), “iPad Usability : First Findings From User Testing”, http://www.useit.com/alertbox/ipad‐1st‐study.html

L’interaction par ajustement avec un objet numérique ne peut se fonder que sur une relation dissymétrique dans la mesure où les deux actants ne sont pas de même nature. Cependant, l’interactivité est tellement sophistiquée qu’elle permet justement d’intensifier la sensibilité réactive des objets numériques et du coup, paradoxalement, de vivre la relation à l’objet comme un corps à corps où chaque partenaire dans une relation certes dissymétrique peut s’ajuster à l’autre, dans une dynamique perçue comme créative. À ce sujet, la livraison des objets Apple sans notice explicative invite à renforcer cette découverte mutuelle des corps où l’usager va procéder par des essais intuitifs, où l’objet va réagir par exemple sur l’iPhone ou l’iPad aux moindres sollicitations du doigt... La mouvance actuelle laisse croire que les modes d’interaction gestuelle fondés sur le tactile sont les plus aptes à provoquer ce corps à corps sensible, assertion que remet en cause Benoît Drouillat5 en citant les travaux de Jacob Nielsen sur les applications pour iPad.6

L’usager est invité à explorer le corps de l’objet avec toute sa sensibilité perceptive cependant que le partenaire objet s’ajuste à l’usager avec sa sensibilité réactive, dans une sorte de danse des corps. Évidemment, ce n’est qu’un point de vue possible de l’interaction, qui peut varier dans son intensité inversement ou en complémentarité avec celui de la programmation.

3. Les travaux antérieurs portant sur le plaisir de la relation à l’objet

Des designers et chercheurs comme Donald A. Norman (2007 ; 2004) ont démontré l’importance des affects qu’un objet, informatique ou non, via son design (forme, aspect, matière) peut générer chez l’usager. Ces travaux s’inscrivent dans le design d’objets en général et ne visent justement pas la spécificité des objets numériques. Bill Moggridge, dans son ouvrage Designing interactions (2007), raconte les réalisations de célèbres designers d’objets numériques en pointant du doigt les différents points de vue des designers et le décalage parfois entre leur volonté et le résultat final. Par exemple, il explique que Doug Engelbart, l’inventeur de la souris, qui envisageait dans ses écrits de 1962 l’interaction entre l’homme et l’ordinateur comme une symbiose, une harmonie, a développé parfois des systèmes d’ingénierie et matériels très performants mais nécessitant un véritable apprentissage, inaccessible pour le grand public, telle la souris qu’il présenta en démonstration en 1968. Il fallait, dit Bill Moggridge avec humour, avoir un doctorat en informatique pour savoir s’en servir ! (2007, 32‐37). Il a le mérite, dans cet ouvrage de mettre en exergue l’importance d’une relation de plaisir dans l’interaction entre l’usager et l’objet.

Pour Moggridge, c’est d’ailleurs la recherche d’une interaction hédonique avec l’objet qui fonde la discipline du design d’interaction : « The discipline […] would start from the needs and desires of the people who use a product or service, and strive to create designs that would give aesthetic pleasure as well as lasting satisfaction and enjoyment. » (Moggridge, 2007, 14) Il relève une double forme de plaisir : plaisir esthétique, plaisir sensoriel mais relate des cas sans pousser l’analyse des systèmes de valeurs à l’œuvre dans ces formes de plaisir. Dan Saffer, quant à lui, dans son ouvrage Designing gestural interfaces, (2008), fait une description très fine de tous les types de geste existants dans les modes d’interaction homme‐machine des interfaces gestuelles. C’est un travail exhaustif sur les interactions qui ne nécessitent pas le recours à la souris ou au stylet mais qui s’en tient à une analyse des avantages et inconvénients ergonomiques, sans creuser les conditions des effets de sens possibles de tel mode gestuel pour telle ou telle action.

Côté sémiotique, Michela Deni (2002) a précisé, en s’inspirant d’ailleurs entre autres des travaux antérieurs de Donald A. Norman, comment le design des dispositifs matériels associés aux interfaces d’objets TIC peut influencer l’appréciation positive que l’usager a de l’objet et orienter l’interaction entre l’usager et la machine dans un climat de confiance, de plaisir.

Alessandro Zinna a quant à lui lancé des pistes de réflexion en s’intéressant à la dimension de l’action dans les objets d’écriture électronique. Pour lui, « la valeur praxéologique des objets reste à saisir. Ce que nous appelons valeurs pratiques […] devient l’usage [de l’objet] et les gestes demandés par son interface ». Mais il limite finalement ses analyses aux images‐icones (par exemple l’image d’une gomme pour effacer) et aux icones d’objets (par exemple un dossier que l’on peut ouvrir ou fermer). Cela, parce que, comme il le dit dans ses travaux de HDR en 2001, dans les années 1990, la plupart des ordinateurs se fondaient sur une gestuelle très limitée : « Strictement, seules deux actions sont nécessaires : le mouvement du bras pour déplacer physiquement la souris sur une surface plane, et le mouvement du doigt sur un bouton ou deux. Cette gestualité réduite enlève toute possibilité de variation de mouvement. Autrement dit, ce que l’homme a appris pendant des siècles, les nuances les plus subtiles et la maîtrise du mouvement du corps, sont d’emblée effacées par la disparition des objets physiques et par la réduction qu’entraîne toute interaction avec des objets virtuels (Zinna, 2001, 117).

Il précise dans une note cependant que les perspectives de la réalité virtuelle vont remettre le geste au centre de l’interaction, avec une recherche de « transparence » au sens d’adéquation entre le geste et l’action : « L’action de jeter un document dans la corbeille sera ainsi le même geste que nous accomplissons pour réaliser cet acte. » (Zinna, 2001, 136). En déplorant une praxéologie alors réduite à l’économie des gestes, il laisse penser que la gestualité, dans l’interaction entre l’usager et les objets numériques, est un axe de sens. Stéphane Hugon (2010), sociologue, fait le même constat en disant que jusqu’au début des années 2000, les objets technologiques étaient pensés davantage pour leurs fonctions que pour la manière d’interagir avec eux. Les interfaces proposaient, dit‐il, une sorte de renoncement du corps en obligeant les usagers à se passer de leur patrimoine chorégraphique, gestuel. L’interaction avec les objets technologiques nécessitait presque un oubli de soi, dit‐il, alors que depuis quelques années, les designers réintroduisent une pluralité de gestes qui nous semblent « naturels ». Pour lui, la transparence d’une interface c’est l’idée de ne pas avoir à réapprendre des gestes pour entrer en interaction avec elle.

Comment aborder le geste dans l’interaction entre l’usager et l’objet TIC numérique d’un point de vue sémiotique ? Tout en expliquant que ce sens se vit pendant l’usage, dans la pratique, Alessandro Zinna définit le geste comme « la narrativité du plan de l’expression. Si la narrativité est le faire sur le plan du contenu, la gestualité est le faire ou le maintien qui vise à construire le mouvement volontaire ou involontaire dans la pratique de l’usage. » (Zinna, 2001, 88). Cette approche ne me semble pas suffisante car la gestualité peut être aussi un axe de sens qui se construit au cours de l’interaction, c’est alors moins une relation de plan de l’expression/plan du contenu porteuse de signification qu’un processus de sens pendant lequel le corps fait émerger des figures.

4. Notre méthodologie

Outre le design des couleurs, des formes, des matières, des icônes, boutons…, le système de valeurs à l’œuvre dans les modalités gestuelles requises pour la coopération contribue à définir un mode d’être à l’objet, un mode de sensibilité spécifique. Il ferait de l’interaction une coopération fondée sur mode sensible et intelligible singulier. Mads Soegaard (2008) a décrit des « styles d’interaction » qui se différencient davantage par l’effet de sens des modalités visuelle et textuelle telles l’interface en ligne de commande, l’interface‐formulaire, l’interface par menus, que par le sens de la modalité gestuelle. Seule la « manipulation directe », dernier « style » qu’il met en valeur et qu’il reprend de Ben Shneiderman (1987) prend aussi en compte le sens des gestes qui se donnent à percevoir comme non codifiés (même s’ils le sont) dans la mesure où ils appartiennent à des gestes de la vie quotidienne que chacun a pu s’approprier, mémoriser au fil de ses expériences avec des supports non informatiques.

4.1. Les critères fondateurs de l’interaction gestuelle

Sur quels critères repose l’interaction gestuelle ? Comment la décrire ? Deux dénominateurs communs fondent les discours scientifiques et médiatiques sur l’interaction entre l’usager et l’objet numérique TIC à écran.

Premier dénominateur commun : la proximité. Il faut distinguer deux acceptions de la proximité :

-

la proximité spatio‐temporelle avec le contenu sur lequel on veut agir et/ou avec l’écran ;

-

la proximité sémiotique à savoir le sentiment de proximité avec les contenus, le sentiment d’une médiation quasi immédiate du contenu.

Deuxième dénominateur commun : la simulation (simulare, feindre, faire paraître comme réel une chose (action) qui ne l’est pas) qui établit des rapports de ressemblances entre deux choses. La simulation repose alors sur une recherche d’analogie(s) soit entre le geste dans l’interaction avec l’objet numérique et le geste que l’on ferait dans la vie courante pour une même action non assistée par un objet numérique soit entre l’interface et l’objet sur lequel on veut agir.

La proximité spatio‐temporelle de l’usager avec l’objet sur lequel il veut agir et/ou avec l’écran repose possiblement sur les critères suivants :

- Note de bas de page 7 :

-

On se rend compte ici que l’expérience que l’usager fait de l’objet dépend aussi de l’environnement (puissance et encombrement du réseau, ergonomie de l’application ou du site).

-

la proximité spatiale du corps par rapport à l’écran (proximité si forte pour des tablettes et téléphones à écran tactile que l’on peut parler de contiguïté, proximité plus forte que pour des téléphones à clavier physique, mais proximité plus forte avec ces derniers qu’avec des ordinateurs de bureau) ;

-

l’aspect plus ou moins long de l’attente du résultat ou latence. Lorsque l’usager attend le résultat, l’interactivité s’impose comme faisant obstacle au bon déroulement de l’action (ex : « ça mouline », pas de retour‐utilisateur7) ;

-

le degré de précision du geste. Lorsque l’usager a du mal à faire des actions précises à cause par exemple d’un espacement trop étroit des items, des caractères, cela donne un effet d’approximation, de distance.

Ces trois critères viennent déterminer la proximité spatio‐temporelle avec l’objet sur lequel on veut agir.

La simulation visant une recherche d’analogie (établissement d’une ressemblance soit entre le geste dans l’interaction avec l’objet numérique et le geste que l’on ferait dans la vie courante pour une même action non assistée par un objet numérique soit entre l’interface et l’objet sur lequel on veut agir) se fonde possiblement sur les critères suivants :

- Note de bas de page 8 :

-

Luce Giard explique le rapport d’instrumentation qui s’établit entre l’utilisateur et l’objet, quand on passe de l’outil à la machine : « Autrefois, la cuisinière se servait d’un outil simple, de type primaire, qui remplissait aussi des fonctions simples ; sa main fournissait l’énergie de mouvement, elle dirigeait le déroulement de l’opération, surveillait la succession des moments de la séquence d’action et pouvait se représenter le processus. Aujourd’hui, elle emploie un outil élaboré, de type secondaire, au maniement compliqué ; elle n’en comprend véritablement ni le principe ni le fonctionnement. Elle alimente cet objet technique en ingrédients à transformer, puis elle déclenche le mouvement en appuyant sur un poussoir, et recueille la matière transformée sans avoir contrôlé les étapes intermédiaires de l’opération. Autrefois, la cuisinière mettait chaque fois en application son savoir‐faire, elle pouvait perfectionner son tour de main, faire montre d’ingéniosité. À présent, n’importe qui peut utiliser l’outil industriel aussi bien qu’elle, elle est devenue le spectateur disqualifié qui regarde la machine fonctionner à sa place. ».

-

les caractéristiques spatiotemporelles du geste. La ressemblance peut s’établir entre les positionnements tridimensionnels du geste (devant, derrière, haut, bas, côté, circulaires), les positionnements aspectuels (bref et intense, duratif et lent, répétitif) et les positionnements du geste effectué dans la vie courante pour la même action non assistée par les objets numériques. L’analogie peut s’établir en outre entre l’aspect du geste et le mouvement que l’on veut faire faire à l’objet médié. L’analogie est restreinte lorsqu’une seule caractéristique spatio‐temporelle du mouvement attendu de l’objet médié est requise dans le geste par exemple, souffler sans indication de durée pour allumer une bougie un temps défini » ; l’analogie est nulle entre le geste et l’action sur l’objet lorsqu’on appuie sur une touche pour faire faire un mouvement à un objet « virtuel » ou accomplir une action ;

-

les caractéristiques sensorielles. L’analogie peut s’établir entre les sensations tactiles telles les vibrations, la rugosité, la douceur ressenties lors de l’accomplissement du geste et celles attribuées à un objet « virtuel » comme on peut l’avoir avec des principes de retour d’effort ou avec des interfaces tangibles. Une analogie de ce type est nulle lorsque les sensations au contact de l’interface n’ont aucune ressemblance avec celles attribuées à un objet « virtuel » comme le fait d’appuyer simplement sur une touche pour pousser un objet qui a une caractéristique tactile particulière ;

-

les caractéristiques figuratives de l’interface. L’analogie peut se fonder sur une ressemblance avec un outil ou objet non numérique que l’on utiliserait dans la vie quotidienne, par exemple, un stylo numérique ou stylet pour écrire à l’écran. L’analogie de ce type est nulle lorsque l’interface, en tout ou partie, diffère totalement d’un outil ou objet non numérique comme le fait d’écrire à l’écran avec des touches. L’analogie figurative peut reposer sur la ressemblance d’un périphérique avec la forme du corps. Cela pour provoquer le sentiment d’immédiateté corporelle de l’usager avec l’objet médié. En effet, le périphérique peut alors être ressenti comme prothèse tel un gant à la place d’une télécommande ;

-

l’aspect continu ou discontinu du geste (aspect discontinu quand l’usager appuie sur une touche pour écrire une lettre, aspect continu lorsqu’ il écrit à l’écran la lettre de manière manuscrite). On peut penser, à la suite d’Erik Landowski (2009, 16) et de Luce Giard (1994, 298)8, que la réduction de l’usager à un presse‐bouton, déclenchant seulement l’action sans la mener en continuité avec son corps comme il peut le faire avec un outil, affaiblit le sentiment de prise sémiotique, le sens de l’action.

Le mode d’interaction gestuelle entre l’usager et l’objet numérique préconisé par les interfaces graphiques et matérielles se fonde sur une combinaison plus ou moins singulière des critères relevant de la proximité spatio‐temporelle et de l’analogie. En ce sens, le mode d’interaction gestuelle constitue un discours (intégré au discours du design global de l’objet) auquel adhère plus ou moins l’usager. L’analyse de la combinaison des critères propres au mode d’interaction gestuelle de chaque objet de notre corpus a mis en valeur des types perceptifs d’interaction gestuelle. Chaque type propose un mode d’être à l’objet médiateur et à l’objet médié particulier. Le plaisir de l’interaction gestuelle repose alors sur l’intensité avec laquelle l’usager adhère à ce mode d’être à l’objet.

4.2. L’analyse de la présence à l’objet médiateur et/ou à l’objet médié

- Note de bas de page 9 :

-

Jean‐François Bordron, en continuité avec la phénoménologie, qualifie la perception comme expression de notre rapport à des qualités sensibles, en amont de qualités axiologiques ou cognitives. Sur ce point, nous ne le suivons pas car les types perceptifs auxquels nous avons affaire avec les modes d’interaction gestuelle impliquent à la fois une présence sensible et un système de valeurs.

Nous faisons l’hypothèse que les types perceptifs fondateurs des modes d’interaction gestuelle ne donnent pas une représentation des objets numériques ni des contenus mais fournissent, pour reprendre la définition de la perception que donne Jean‐François Bordron, « une expression de notre rapport à des qualités » (2011, 180). Ces qualités, nous les définissons comme étant à la fois sensibles et axiologiques9. Chaque type perceptif en l’occurrence constituerait une expression de qualités spécifiques qui fondent notre relation à l’objet numérique et aux objets médiés par ce dernier. Jean‐François Bordron rappelle que la perception est « d’abord une mise en présence, et, en ce sens, un événement » (Bordron, 2011, 181).

Le concept de présence chez Jacques Fontanille et Claude Zilberberg désigne la perception d’une relation de présence entre un sujet et un objet : « la présence sémiotique ne peut être que relationnelle et tensive, et doit être comprise comme « une présence de x à y » (1998, 95).

Pourtant, ces auteurs‐ci définissent la présence par deux gradients : l’intensité de la visée perceptive (la source de la perception vise une cible dans son champ de présence avec plus ou moins d’intensité), l’étendue spatio‐temporelle de la saisie perceptive (ce qui est visé par la source et que l’on nomme la cible de la perception apparaît avec plus ou moins d’extension) qui caractérisent le champ discursif du sujet de perception sans penser à ajouter le gradient de la relation. C’est cette troisième catégorie que propose de prendre en compte Jean‐François Bordron (2011, 182). Mais ce dernier conçoit la relation « interne à la phénoménalité elle‐même » et non en tant quelle serait « le fait d’un sujet percevant rencontrant quelque objet » alors que dans notre étude nous considérons la manière dont chaque type perceptif lié au mode d’interaction gestuel tisse la relation de présence entre un sujet perceptif (l’usager), un objet médiateur et un objet médié.

Nous retenons pour notre analyse des types perceptifs à l’œuvre dans les modes d’interaction gestuels les gradients :

-

de qualité (l’objet médiateur propose une mobilisation du corps de l’usager plus ou moins intense) ;

-

de quantité (l’objet médiateur propose une étendue spatio‐temporelle des gestes à accomplir plus ou moins marquée) ;

-

de relation (l’objet médiateur propose une relation plus ou moins continue ou discontinue entre le corps de l’usager, l’objet médiateur et l’objet médié).

- Note de bas de page 10 :

-

Les actants sont des forces et des rôles nécessaires à l’accomplissement d’un procès. On distingue, selon J. Fontanille, les actants narratifs proposés par le schéma narratif structuraliste, tels le sujet, l’objet, le destinateur, le destinataire, l’adjuvant et l’opposant, des actants positionnels qui sont définis par leur place dans le champ positionnel du discours ou champ de perception. La source de perception vise quelque chose (la visée), elle vise une cible et lorsqu’elle perçoit la cible, elle la saisit (c’est l’acte de saisie). Pour en savoir plus, voir Fontanille et Zilberberg (1998, 139‐140).

- Note de bas de page 11 :

-

Jean‐François Bordron explique la différence entre la signification et le sens ainsi : « Ainsi, reconnaître une différence entre sens et signification ne revient pas à distinguer ce qui est vague de ce qui serait précis, mais plutôt ce qui est individuel de ce qui serait public. » (2011, 196).

En ce qui concerne le gradient de qualité, l’objet médiateur peut se fonder sur un mode d’interaction gestuelle donné à percevoir comme un système, une forme codifiée, à savoir un système d’unités ayant une fonction de différenciation les unes par rapport aux autres. En ce cas, l’usager peut interagir gestuellement sans s’impliquer, sans se mobiliser sur le fonctionnement de l’objet médiateur. La présence de l’objet médiateur dans le champ discursif de l’usager est alors faible, non‐ intense. Le mode d’interaction gestuelle est donné comme une habitude, un automatisme. L’usager, source de perception10, est incité à adopter une visée faible de l’objet médiateur, une sorte d’indifférenciation pour se concentrer sur l’objet médié. En ce cas, l’interaction gestuelle prend le statut de modalité. Elle fonctionne comme une signification, c’est un système codifié à disposition de l’usager pour agir sur l’objet médié mais n’a pas de sens en soi pour l’usager. Le type d’interaction gestuelle ne fait pas appel au corps comme substance ou dispositif11 capable de générer, en s’impliquant dans l’interaction, des icones au sens de formes existantes ou nouvelles émergeant dans leur relation au corps de l’usager mais au corps comme exécutant des formes utilitaires et codifiées12.

Si au contraire le mode d’interaction gestuelle sollicite intensément le corps de l’usager au sens où il l’implique dans son rapport à l’objet médiateur, en ce cas, la présence de l’objet médiateur dans le champ discursif de l’usager est intense. L’interaction gestuelle prend alors le statut de forme iconique vécue comme une gestualité de sportifs, de musiciens, de danseurs, de joueurs… Cette perception du geste comme forme iconique générée à partir du corps‐dispositif et non comme instrument se donne à vivre alors non comme un ensemble de règles publiques, usuelles mais comme puisant leur sens de façon singulière dans leur relation au corps de l’usager. C’est ainsi que Bordron, rappelons‐le, distingue le sens, singulier, personnel, de la signification, codifiée, publique.

En ce qui concerne le gradient de quantité, le mode d’interaction gestuelle peut se fonder sur des gestes plus ou moins longs et étendus ou brefs et concis. Les modes d’interaction gestuelle qui jouent sur des analogies ou recherche de rapports de ressemblance entre le geste dans l’interaction avec l’objet numérique et le geste que l’on ferait pour une même action non assistée par un objet numérique font appel à une étendue beaucoup plus marquée que les gestes qui ne recherchent pas d’analogies. Ce faisant, ils fondent le statut iconique qui fait sens pour l’usager dans la mesure où c’est l’acte d’effectuation du geste par le corps de l’usager qui prime sur le résultat. En revanche, quand les gestes consistent principalement à appuyer sur des boutons ou des touches, à cliquer ou à taper du doigt sur des liens ou sur tout autre signe fonctionnel à l’écran, l’étendue des gestes est restreinte, fondant un système codifié, une modalité qui cherche en priorité l’efficacité sur l’objet médié.

Enfin, le gradient de relation vient déterminer le type de relation qui s’établit entre le corps de l’usager, l’objet médiateur et l’objet médié. Les modes d’interaction gestuelle qui recherchent une analogie entre le geste dans l’interaction avec l’objet numérique et le geste que l’on ferait pour une même action non assistée par un objet numérique recherchent une relation de continuité entre le corps de l’usager (avec sa mémoire des gestes, ses pratiques culturelles, son environnement physique), et l’objet médié (l’environnement, le contenu médié. L’objet médiateur vient assurer cette continuité. En revanche, quand le mode d’interaction gestuelle consiste à proposer une forme codifiée, un système d’unités pour agir sur l’objet médié, il y a une relation de discontinuité entre l’usager et l’objet médié (l’objet médiateur ne cherche pas à établir des affinités entre le geste de l’usager et les actions faites sur l’objet médié). Si le mode d’interaction ne nécessite aucun apprentissage cependant, les codes étant déjà utilisés avec d’autres interfaces, il y a certes une relation de discontinuité entre l’usager et l’objet médié mais aussi une relation de continuité entre l’usager et l’objet médiateur, des affinités temporelles ayant été créées par la mémoire. Si le l’objet médiateur met en valeur la nécessité d’apprentissage de la part de l’usager, il y a une relation de discontinuité entre l’usager et l’objet médiateur.

5. Les différents types de modes d’interaction relevés

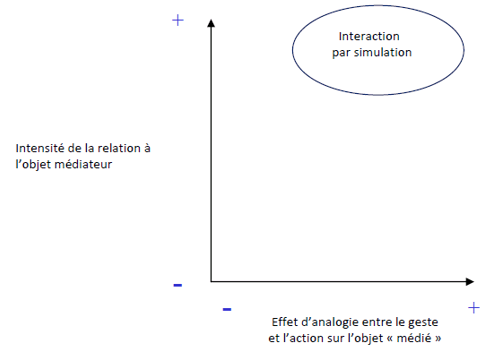

5.1. L’interaction par simulation

Certaines interfaces d’objets numériques à écran fondent l’interaction sur une analogie relativement étendue entre les gestes effectuées via l’interface et les gestes qui seraient sollicités pour une même action dans un environnement physique. L’interaction par simulation a été décrite sous le terme de « direct manipulation » par Ben Shneiderman (1987). Dans Designing the User Interface : Strategies for Effective HumanComputer Interaction, ce dernier explique qu’un type d’interfaces fonde l’interaction avec l’usager sur des métaphores d’actions et de gestes effectués dans un environnement. Contrairement aux discours ambiants qui finalement font de l’iPhone le symbole de ce mode d’interaction innovant, un regard sur l’histoire des objets numériques montre que ce mode d’interaction s’inscrit depuis très longtemps dans les préoccupations des designers.

Ainsi, en 1989, le Power Glove est un accessoire pour la NES Nintendo Entertainment System qui fait office de manette. Doté de capteurs, il permet la reconnaissance des mouvements du joueur. Une fois le gant enfilé, le joueur doit lever le bras pour faire sauter le personnage, pointer l’écran du doigt pour tirer, ou encore mimer les mouvements du volant pour conduire. On a alors sur l’axe vertical, la contiguïté non pas de l’écran mais du gant qui épouse la forme du corps, l’aspect continu du geste, sur l’axe horizontal, les caractéristiques tridimensionnelles. L’interface, si elle est visible, évidente, permet aussi la simulation, le faire, comme si on jouait dans un environnement physique sans prétendre pour autant à la transparence. Cette dernière, selon Alessandro Zinna, suppose en effet l’invisibilité de l’interface, « leur phénoménologie de manifestation serait ainsi une anti‐phénoménologie, dans le sens que ces interfaces auraient tendance à disparaître en tant qu’instances de médiation entre l’homme et la machine. » (2001, 83).

- Note de bas de page 12 :

-

Cf. note 1.

On ne peut plus ainsi, dans le cas d’une intégration de la machine au corps humain, parler d’interaction entre l’usager et l’objet numérique. L’interaction suppose une dualité minimale. Asimov prétend qu’une bonne interface doit être transparente de manière à ce que l’on puisse vivre en symbiose avec la machine. Mais selon Jean Caelen12, ce mode d’interaction n’est pas idéal ; il ne pourrait pas procurer de plaisir car il n’offre aucune résistance, la transparence, dit‐il, n’étant pas « palpable ».

Sortie en 2005, la DS de Nintendo permet à l’usager, selon les jeux, d’utiliser la voix (appeler son chien dans Nintendogs), le stylet pour dessiner, tracer des directions (Soul Bubbles) ou frotter, ou encore souffler dans le micro de la console (pour éteindre une bougie dans Zelda). Dans une proximité physique avec l’écran, l’usager peut utiliser le stylet pour dessiner et pour activer une icône, peut se vivre comme prolongement du corps, comme un crayon, avec une continuité gestuelle analogue à celle nécessaire pour dessiner ou écrire à la main. La voix, le souffle, s’inscrivent eux aussi dans cette continuité gestuelle.

La console WII sortie en 2006 propose pour certains jeux d’intégrer la manette à des instruments réels tels qu’une guitare ou une raquette de tennis. En ce cas, la manette est proposée comme prolongement naturel du corps, comme un outil. Les gestes analogiques requis ont fait la réputation populaire de la console.

- Note de bas de page 13 :

-

Je tiens très sincèrement à remercier Benoît Drouillat pour m’avoir fait découvrir des initiatives récentes en termes de design numérique. Pour Orange Gestures, cf. http://multi‐ecran.com/expo/orange‐gestures‐interactions‐tactiles‐et‐gestuelles‐multi‐ecrans.

L’exposition sur le multi‐écran organisée par l’association *designers interactifs*, dont le commissariat a été assuré par Benoît Drouillat, met l’accent sur des initiatives telles que celle d’Orange Labs avec Orange Gestures lancé en 2011 et fondé sur une interaction par simulation de gestes habituels dans la vie courante : « Par exemple, quelqu’un qui regarde ses photos sur son smartphone pourrait décider d’un geste de les « lancer » vers son PC ou sa TV pour les regarder cette fois en famille. […] Les utilisateurs peuvent désormais dessiner des gestes naturels et intuitifs sur l’écran d’accueil de leur mobile donnant ainsi accès directement, en un tracé, à leurs applications, services ou contacts favoris. »13

Ce mode d’interaction par simulation se fonde sur une double équivalence sémantique : intensité de la relation à l’objet médiateur + analogie relativement étendue = continuité entre l’usager et l’objet médié = plaisir de l’interaction.

Ces objets promettent à l’usager de faire comme s’il se trouvait en situation d’action dans un environnement physique, avec des objets non numériques mais en trouvant du sens dans la relation à l’objet médiateur. La modalité gestuelle implique ici la relation entre les gestes comme formes iconiques et le corps, l’acte d’interagir étant vécu comme intense, dans une relation de continuité (avec sa mémoire des gestes, ses pratiques culturelles, son environnement physique), et l’objet médié. Bien entendu, ce type de mode d’interaction est un discours fondé sur un système de valeurs, une conception du plaisir de l’interaction particuliers et ce discours sur l’objet médiateur montre parfois des décalages entre ce qu’est censé proposer ce dernier et ce qu’il propose effectivement. Pour interagir avec ces différents objets, il doit effectuer des paramétrages et/ou installer un dispositif (par exemple, pour l’iPad, il faut la synchroniser avec son ordinateur pour la mettre à jour, sinon on ne peut plus télécharger d’applications). Outre ces contraintes, dans certains cas, les systèmes encore imparfaits de reconnaissance vocale, gestuelle, font obstacle à la relation de continuité entre le sujet, l’objet médiateur et l’objet médié que l’usager peut vivre au cours de l’interaction avec des objets numériques. Ainsi, on sait que le Body Pad qui permet à l’usager de mener un combat de manière analogique à un combat dans un environnement physique est moins efficace que la manette de jeu.

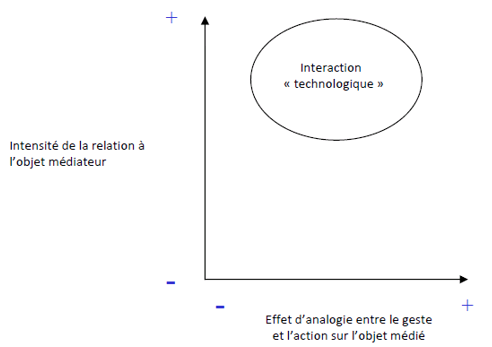

5.2. Le type d’interaction par apprentissage

Certains objets numériques proposent une interaction qui n’entretient aucune analogie avec les outils ou objets requis pour une situation d’action non interactive. On peut prendre l’exemple d’une manette de jeu valable pour divers jeux ou d’une souris montrant la nécessité d’un réel apprentissage des commandes et des gestes.

Citons un clavier spécifique, le Warrior Xxtreme de WolfKing sorti en 2007. Considéré comme le premier clavier au monde à conjuguer un clavier et un gamepad, la disposition de ses touches est optimisée pour les joueurs de jeu de rôle en ligne et plus particulièrement de jeu de tir à la première personne. À droite du clavier sont présentes toutes les touches d’un clavier classique, disposées en rond : le but est que l’utilisateur puisse taper du texte à une main (ex. : écrire dans le chat des jeux). À gauche se trouvent les touches qu’utilisent principalement les joueurs. La barre d’espace est à la verticale et sa largeur est augmentée, la touche CTRL figure en deux exemplaires et certaines touches sont plus larges pour maximiser le confort et optimiser le contrôle de la frappe. Après un apprentissage du clavier et l’acquisition d’une certaine dextérité, l’usager peut se sentir en harmonie avec l’interface, jouer rapidement (faire baisser la latence) et ressentir le clavier en continuité avec son corps. Des affinités non pas analogiques mais cohésives se créent entre les gestes de l’usager qui rendent ce dernier inséparable de l’objet médiateur et en même temps intensément absorbé par l’objet médié. Les joueurs avertis par exemple transforment, au cours de l’interaction, en une seule unité le corps, l’objet médiateur et l’objet médié.

Ce mode d’interaction se fonde ici sur une double équivalence sémantique : intensité de la relation à l’objet médiateur et à l’objet médié + analogie restreinte = relation de continuité entre le corps, l’objet médiateur et l’objet médié = plaisir de l’interaction.

En ce cas, le plaisir passe par une mise à l’épreuve des compétences d’apprentissage de l’usager, des compétences corporelles et de mémorisation pour ensuite se vivre en harmonie, en cohésion avec l’interface. La modalité gestuelle est vécue doublement comme signification (les gestes ne cherchent pas vraiment d’analogie avec les actions menées sur l’objet médié et l’ensemble des gestes à effectuer est donné à percevoir comme système syntaxique efficace, productif) mais aussi comme sens. L’acte d’interagir est à vivre intensément, avec art, avec tact, et en ce sens, les gestes en devenir, en train de se faire forment des icones dépendantes du corps qui les effectuent. Si l’usager ne se reconnaît pas dans une interface résistante, l’interaction par apprentissage peut être refusée. Ainsi, Benoît Drouillat, dans ses travaux sur les applications de première génération pour l’iPad note très justement que les codes gestuels relativement sophistiqués utilisés par le journal Le Figaro par exemple (ex. : poser les 2 pouces à la surface de l’écran pour faire apparaître le menu) avaient été perçus comme nécessitant un effort de découverte et d’apprentissage trop important.

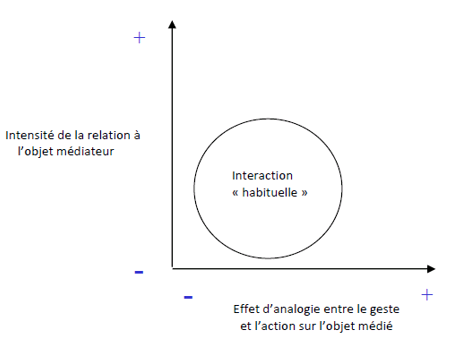

5.3. L’interaction par habitude

Certains objets proposent des interfaces se montrant comme des modalités, n’entretenant aucune analogie avec les gestes faits pour les mêmes actions dans un environnement physique mais qui sont habituels pour l’usager dans un environnement informatique.

En ce cas, la modalité gestuelle ne se donne pas à vivre comme forme iconique liée à au corps comme forme codifiée, usuelle. L’interaction gestuelle est donnée à vivre comme signification, non comme sens.

C’est en général le cas des liseuses ou tablettes de lecture tel le REB 1 200 sorti en 2000 avec ses boutons et flèches habituels. Un bouton menu est situé en haut à gauche de l’appareil. L’utilisateur clique dessus pour ouvrir le menu qui est contextuel, selon que le mode actif est lecture ou bookstore, et propose des options variées. Sur le côté droit de l’appareil, on trouve en haut deux molettes qui permettent de régler luminosité et contrastes. Dessous, un bouton permet de tourner les pages : on clique sur la flèche de droite pour passer à la page suivante, on clique sur la flèche de gauche pour revenir à la page précédente.

Pour accéder à la bibliothèque, l’utilisateur doit presser le bouton situé en haut à droite de l’appareil. Pour tourner les pages, l’utilisateur peut également utiliser la barre de navigation située en bas de l’écran : faire glisser le slider avec le doigt ou le stylet, relâcher la pression > la page s’ouvre. Pour marquer une page, l’utilisateur tape le coin supérieur de la page avec le stylet. Un symbole apparaît. Il suffit de retaper dessus pour l’annuler. Ces gestes sont habituels pour tout usager des ordinateurs traditionnels.

On peut encore citer le cas de la borne libre SNCF sorti en 1989. L’usager est confronté à un écran d’accueil, il valide son choix en cliquant du doigt sur l’écran, à l’endroit du bouton qui l’intéresse. La validation s’effectue en pressant l’écran du doigt à l’endroit du bouton de validation. Pour retirer un billet, l’utilisateur peut avoir à entrer son nom et/ou la référence de son dossier au moyen d’un clavier tactile qui apparaît à l’écran. En ce cas, l’écran tactile, combiné à des gestes non continus tels qu’appuyer comme on appuie sur une touche, placent l’usager dans un environnement de machines. Dans ce mode d’interaction, il fait appel à sa mémoire des machines, de leurs usages, de leurs codes. Il agit automatiquement.

Nous préférons qualifier ce mode d’interaction d’« ordinaire » plutôt que d’« intuitif », ce qualificatif étant sujet à polysémie est étant inadéquat, dans la mesure où toute forme d’interaction entre l’homme et la machine est fabriquée, construite.

Le mode d’interaction gestuelle se fonde ici sur une double équivalence sémantique : Relation atone, non‐intense entre le corps de l’usager et l’objet médiateur + analogie restreinte = relation de discontinuité entre le corps de l’usager et l’objet médié = plaisir de l’interaction.

Dans le type d’interaction gestuelle par simulation, le plaisir de l’interaction porte avant tout sur l’acte d’interagir, sur la relation intense du corps à l’objet médiateur et sur une relation de continuité entre le corps et l’objet médié. Le geste, forme iconique, est à vivre comme sens, non comme signification. On retrouve ici une attitude de plaisir fondée sur ce qu’Erik Landowski appelle l’ajustement entre la sensibilité perceptive du sujet et la sensibilité réactive de l’objet. Le plaisir est alors le sentiment de présence à l’objet, comme l’indiquent Husserl et Ouellet. La relation syntaxique entre le sujet et l’objet (médiateur, médié) est une relation de réciprocité.

Dans le type d’interaction par habitude ou même routine, le plaisir de l’interaction porte non pas sur l’acte d’interagir mais sur le résultat sur l’objet médié. La relation du corps à l’objet médiateur est atone, la relation entre le corps et l’objet médié est discontinue, aucune affinité n’étant cherchée. Le geste, modalité, est donné à vivre comme signification, comme système codifié, non comme sens. L’attitude de plaisir porte alors sur la liquidation d’un manque. On est dans le type d’interaction qu’Erik Landowski appelle la programmation, à savoir une relation instrumentalisée des partenaires, une relation de cause à effet. La relation du sujet vers l’objet médiateur est transitive.

Dans le type d’interaction gestuelle par apprentissage, le plaisir de l’interaction porte sur l’acte d’interagir autant que sur le résultat sur l’objet médié, il porte sur la relation intense du corps à l’objet médiateur et sur une relation de continuité cohésive, non analogique, entre le corps, l’objet médié et l’objet médiateur. La modalité gestuelle est donnée à vivre comme sens, mais aussi comme signification.

Bien entendu, certains objets médiateurs peuvent croiser des types de mode d’interaction gestuelle différents. L’Iphone, par exemple, ou l’iPad jouent sur certaines analogies entre les gestes requis et les actions menées sur l’objet médié (l’espacement dans le geste d’écarter pour élargir du texte ou une image) mais aussi sur l’illusion que le système codifié ne nécessite pas d’apprentissage et que l’on peut se concentrer sur l’objet médié.

Mais, malgré le discours que propose chaque interface, chaque type d’interaction peut être vécu, en usage comme relation instrumentalisée en vue d’un résultat ou comme processus et expérience sensible, même si les deux niveaux ne sont pas du tout inconciliables, comme l’explique parfaitement Erik Landowski (2009, 18). Précisément, l’interaction perçue comme résultat, efficacité, suppose que le corps de l’usager comme celui de l’objet sont des instruments qui servent à activer des commandes et à répondre à l’activation des commandes via un processus interactif. Différemment, l’interaction perçue comme processus, art de faire, suppose que les corps de l’usager et de l’objet trouvent, au cours de la relation, une dynamique, s’ajustent l’un à l’autre, dans une sorte, non plus d’opération mais de coopération. Il nous reste évidemment à replacer l’expérience gestuelle de l’interaction dans l’ensemble des types d’expériences qu’offrent les interactions avec les objets numériques pour en préciser les spécificités (expérience esthétique, ergonomique, expérience de la performance, …).